公有云巨头纷纷瞄准企业生成式AI开发需求,推出了各自的GAI技术架构和开发组件。紧接在11月底AWS披露GAI产品战略之后,Google也在12月初,发布了最新也是他们最强的LLM模型Gemini,隔周更在GCP的AI开发组件Vertex AI上发布了企业用的Gemini Pro版模型预览版,开放企业免费试用。Google同步推出Web版AI Studio开发工具,也将自家MLOps开发平台Vertex AI转为聚焦企业GAI开发的LLMLOps平台,要涵盖开发、部署到运维更多模型生命周期阶段的需求。

Google在12月初正式发布了Gemini,包括高端Ultra版,中端Pro和低端Nano版模型。Gemini Ultra将可以同时分辨和理解文本、图片和声音,也可以用来分辨和解释几种热门开发语言,包括Python、Java、C++。Google推出Gemini模型时就强调,与其他知名大型语言模型如GPT、LLama最大差异是将提供一个移动设备的小参数模型Nano版Gemini。

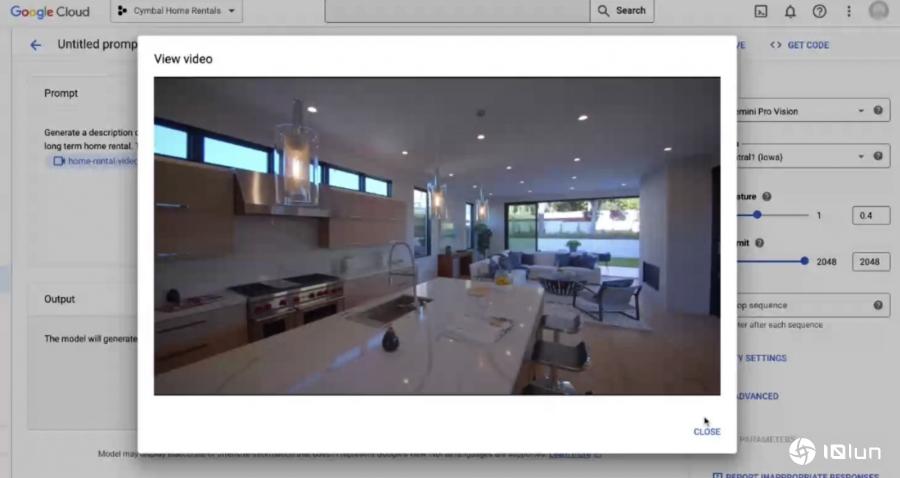

Google先在Vertex AI平台上架了Gemini Pro模型API预览版,这是Gemini三款模型中的中端款。又细分为两款API,目前只支持文本输入和文本生成的Gemini Pro,最大可以输入32K个Token,支持38种语言。另外,也提供了Gemini Pro Vision端点,可接受文本和图片输入,但只能输发文本,Google在记者会上实测展示时,则可以直接输入一段视频,让模型来判读视频中的元素。Google用“模型端点”而非另一款模型来形容第二款API,意味着,这是同一个Gemini Pro模型,只是多发布图片功能API来区隔版本。

Vertex AI上已经可以选择Google新版LLM模型Gemini Pro版本,也可使用Gemini Pro Vision版本,可直接上传一段视频,让模型来分析视频中的元素。

Gemini Pro从现在开始提供企业和开发者免费测试,2024年才开始正式收费,输入和输出都要计价,将按输入文本每千字0.00025美元或每张图0.0025美元,而输出则是每千字0.005美元。

而Gemini Pro的SDK目前支持了数据科学主流语言Python、两大移动平台Android的Kotlin和iOS应用的Swift,另外还包括了Web前后端开发主流JavaScript和Node.js语言。从Pro版SDK所支持开发语言种类更可以反映出,Gemini Pro格外注重未来的移动AI应用开发需求。

除了自家新模型之外,Vertex AI的模型花园中,也一并增加了文本生成图片的Imagen 2模型,可以生成更拟真的图片。另外也将在数周后发布了一个以Med-PaLM 2模型为主打造的医疗GAI模型产品集称为MedLM,中国医药大学附设医院将是亚洲第一家采用这款医疗GAI模型的医学中心。用医疗数据微调过的Med-PaLM 2以85分高分通过了美国医生执照考试,可以达到医疗专科医生的回答水准。

除了新模型上架化,Google也正式推出了免费的Web版GAI开发工具AI Studio,(前身是MakerSuite),默认就是使用Gemini Pro或Gemini Pro Vision来开发AI应用,每分钟可以免费使用60次模型请求。实测AI Studio,目前已经可以输入中文,也能产生繁体中文的内容,不过,AI Studio上的Gemini Pro模型目前只支持到2023年8月的数据。

Google在今年5月开始大幅升级机器学习开发平台Vertex AI,更聚焦提供各种生成式AI的开发工具。在这个平台的模型花园清单上,提供了超过130种通过Google企业级安全品质审查的ML模型,包括了开源和第三方提供的商用模型。在模型定制化上,这个平台提供了多项微调方法,例如提示设计、LoRA微调、人类反馈增强学习RLHF等。

随着这次新模型发布同时,Google也宣布了多项Vertex AI更多新功能,从模型增强,与外部数据或API的互动,多模型的协作框架,自动化模型评比,更多GAI控制机制等,逐渐从模型开发,延伸到了模型部署,运维管理等LLM模型的MLOps流程。

Vertex AI增强工具主要提供三大功能,包括强化搜索常用的嵌入检索机制,设置配置就能快速构建的RAG(检索增强生成)工具,也可以串联外部的矢量数据库,图片或影音转换成矢量后可以存储到矢量数据库,通过Vertex AI使用Gemini来实现多模态的嵌入检索,可使用GCP托管或第三方的矢量数据库。Vertex AI将提供到18种不同的GAI控制或负责任管控机制,例如可以自动引用连接检查,企业基础正确性比较,或像是不宜用语和不雅图片过滤等。

此外,Google也将陆续提供3项模型与外部环境互动的能力,8月先宣布了预览版插件机制(Extension),可以连接到外部数据源或是外部应用,让生成式AI模型可以取得即时的外部资讯,甚至可以代表模型操作者的身份,在授权后取得个性化的AP数据。后续,Google将添加“函数调用”(Function Calling)能力,可以将Gemini生成的结果自动导出成一只API或一只函数程序。企业可以在这只功能性API中再次优化模型输出的结果。

另外一项将添加的功能是调度(Orchestration)多模型协同运行的能力,Vertex将可以用来调度多个模型互相运行。例如在手机上用Nano版模型接收用户口语的问题,先将问题声音转成文本后,再抛转到云计算的Pro版模型来生成回答,然后再抛转给用户。Google将提供一套调度框架,可以用来串联和连接不同模型共同产生更好的回应内容。不过,Google还没披露这套调度框架的发布进程。

在这次新版Gemini预览版发布同时,Google也披露了Vertex AI平台多项模型评估和部署新功能,模型自动评估矩阵从单一模型评估,添加加了多模型评比功能Auto SxS,可以一对一自动比较两个模型对指定任务的执行结果,例如进行不同模型的A/B测试之用,或是比较微调前后,或相同模型但不同参数大小的效果。当模型部署上线后,可以关注每一次回应从输入到输出的速度来了解模型性能。

Google新推出的AI Studio与Vertex AI采用了相同的数据安全和隐私管控机制,都可以支持顾客自带密钥、VPC控制、访问透明度记录和IAM权限管控。Google Cloud首席执行官Thomas Kurian在发布记者会上强调,企业数据只有企业自己可以访问,其他任何人,就连Google都无法看到模型输入、输出或每一项人类反馈到企业模型的数据。

今年3月,Google发布了NoCode的AI工具Vertex AI Studio,主要提供两种常见企业AI应用的快速开发,包括了“搜索”和“对话”应用,这两项应用将会在2024年初开始支持Gemini模型。目前搜索功能只能针对单一数据源查询,2024年时将添加一项“混合搜索”(Blended Search)应用,只需要输入一个搜索指令,就能用Gemini来搜索不同数据源上的多模态数据,包括企业内部私有的结构化数据与非结构化数据,还有外部的公开数据。

Google预计在2024年初正式推出Gemini模型后,会集成到更多服务中,包括了Google企业级高端搜索服务将开始支持多模态嵌入矢量搜索。而Duet AI for Workspace明年初也会引进Gemini模型,可以对分析内容提供多模态的高端理解能力。